PyTorch 튜토리얼

- https://pytorch.org/tutorials/beginner/blitz/tensor_tutorial.html

- https://tutorials.pytorch.kr/beginner/basics/intro.html

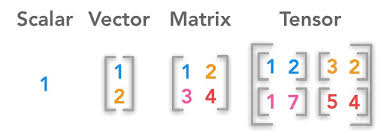

텐서는 배열 및 행렬과 매우 유사한 특수한 데이터 구조입니다. PyTorch에서는 텐서를 사용하여 모델의 입력과 출력은 물론 모델의 매개변수도 인코딩합니다.

텐서는 GPU나 기타 특수 하드웨어에서 실행되어 컴퓨팅을 가속화할 수 있다는 점을 제외하면 NumPy의 ndarray와 유사합니다.

Python 기반의 패키지로 다음과 같은 두 가지를 대상으로 합니다:

- NumPy를 대체하고 GPU의 연산력을 사용

- 최대한의 유연성과 속도를 제공하는 딥러닝 연구 플랫폼

Pytorch 기본 익히기

파이토치(PyTorch)에는 데이터 작업을 위한 기본 요소 두가지 요소가 존재합니다torch.utils.data.DataLoader 와 torch.utils.data.Dataset로 Dataset 은 샘플과 정답(label)을 저장하고, DataLoader 는 Dataset 을 순회 가능한 객체(iterable)로 감쌉니다.

import torch

from torch import nn

from torch.utils.data import DataLoaderfrom torchvision import datasets

from torchvision.transforms import ToTensor

# 공개 데이터셋에서 학습 데이터를 내려받습니다.

training_data = datasets.FashionMNIST(

root="data",

train=True,

download=True,

transform=ToTensor(),

)

# 공개 데이터셋에서 테스트 데이터를 내려받습니다.

test_data = datasets.FashionMNIST(

root="data",

train=False,

download=True,

transform=ToTensor(),

)

dataloader를 통해 순회 가능한 방식으로 변환하고 각 데이터를 확인합니다.

batch_size = 64

# 데이터로더를 생성합니다.

train_dataloader = DataLoader(training_data, batch_size=batch_size)

test_dataloader = DataLoader(test_data, batch_size=batch_size)

for X, y in test_dataloader:

print(f"Shape of X [N, C, H, W]: {X.shape}")

print(f"Shape of y: {y.shape} {y.dtype}")

break

nn.Module을 상속받는 클래스를 생성하여 정의합니다.

batch_size = 64

# 데이터로더를 생성합니다.

train_dataloader = DataLoader(training_data, batch_size=batch_size)

test_dataloader = DataLoader(test_data, batch_size=batch_size)

for X, y in test_dataloader:

print(f"Shape of X [N, C, H, W]: {X.shape}")

print(f"Shape of y: {y.shape} {y.dtype}")

break

- __init__ 함수에서 신경망의 계층(layer)들을 정의하고 forward 함수에서 신경망에 데이터를 어떻게 전달할지 지정합니다. 가능한 경우 GPU 또는 MPS로 신경망을 이동시켜 연산을 가속(accelerate)합니다.

# 학습에 사용할 CPU나 GPU, MPS 장치를 얻습니다.

device = (

"cuda"

if torch.cuda.is_available()

else "mps"

if torch.backends.mps.is_available()

else "cpu"

)

print(f"Using {device} device")

# 모델을 정의합니다.

class NeuralNetwork(nn.Module):

def __init__(self):

super().__init__()

self.flatten = nn.Flatten()

self.linear_relu_stack = nn.Sequential(

nn.Linear(28*28, 512),

nn.ReLU(),

nn.Linear(512, 512),

nn.ReLU(),

nn.Linear(512, 10)

)

def forward(self, x):

x = self.flatten(x)

logits = self.linear_relu_stack(x)

return logits

model = NeuralNetwork().to(device)

print(model)

NeuralNetwork(

(flatten): Flatten(start_dim=1, end_dim=-1)

(linear_relu_stack): Sequential(

(0): Linear(in_features=784, out_features=512, bias=True)

(1): ReLU()

(2): Linear(in_features=512, out_features=512, bias=True)

(3): ReLU()

(4): Linear(in_features=512, out_features=10, bias=True)

)

)

모델을 학습시키고 개선하기 위해서는 손실 함수(loss function) 와 옵티마이저(optimizer) 가 필요합니다.

loss_fn = nn.CrossEntropyLoss()

optimizer = torch.optim.SGD(model.parameters(), lr=1e-3)

각 학습 단계(training loop)에서 모델은 (배치(batch)로 제공되는) 학습 데이터셋에 대한 예측을 수행하고, 예측 오류를 역전파하여 모델의 매개변수를 조정합니다.

def train(dataloader, model, loss_fn, optimizer):

size = len(dataloader.dataset)

for batch, (X, y) in enumerate(dataloader):

X, y = X.to(device), y.to(device)

# 예측 오류 계산

pred = model(X)

loss = loss_fn(pred, y)

# 역전파

optimizer.zero_grad()

loss.backward()

optimizer.step()

if batch % 100 == 0:

loss, current = loss.item(), (batch + 1) * len(X)

print(f"loss: {loss:>7f} [{current:>5d}/{size:>5d}]")

학습이 정상적으로 진행되었는지 검승하기 위해 테스트 데이터셋으로 모델의 성능을 확인합니다.

def test(dataloader, model, loss_fn):

size = len(dataloader.dataset)

num_batches = len(dataloader)

model.eval() #모델 평가 모드로 변경

test_loss, correct = 0, 0

with torch.no_grad():

for X, y in dataloader:

X, y = X.to(device), y.to(device)

pred = model(X)

test_loss += loss_fn(pred, y).item()

correct += (pred.argmax(1) == y).type(torch.float).sum().item()

test_loss /= num_batches

correct /= size

print(f"Test Error: \\n Accuracy: {(100*correct):>0.1f}%, Avg loss: {test_loss:>8f} \\n")

Epochs를 통한 모델을 반복 학습시키기

epochs = 5

for t in range(epochs):

print(f"Epoch {t+1}\\n-------------------------------")

train(train_dataloader, model, loss_fn, optimizer) # 훈련

test(test_dataloader, model, loss_fn) # 테스트

print("Done!")

모델을 저장하기

torch.save(model.state_dict(), "model.pth")

print("Saved PyTorch Model State to model.pth")

모델을 불러오는 과정에는 모델 구조를 다시 만들고 상태 사전을 모델에 불러오는 과정이 포함됩니다.

model = NeuralNetwork().to(device)

model.load_state_dict(torch.load("model.pth"))

모델을 사용하여 예측합니다.

# 해당되는 10개의 class로 분류됩니다.

classes = [

"T-shirt/top",

"Trouser",

"Pullover",

"Dress",

"Coat",

"Sandal",

"Shirt",

"Sneaker",

"Bag",

"Ankle boot",

]

model.eval()

x, y = test_data[0][0], test_data[0][1]

with torch.no_grad():

x = x.to(device)

pred = model(x)

predicted, actual = classes[pred[0].argmax(0)], classes[y]

print(f'Predicted: "{predicted}", Actual: "{actual}"')

tensor([[-2.2504, -2.4639, -0.8681, -1.9371, -1.1067, 2.3279, -1.0071, 2.6530, 1.7159, 3.0928]])

# 테스트 이미지가 10개의 클래스 중 Ankle boot와 가장 가까운 것으로 예측되었고 실제 Actual과 유사한 것을 확인할 수 있습니다.

Predicted: "Ankle boot", Actual: "Ankle boot"

'TIL > 개념정리' 카테고리의 다른 글

| Docker 배포 최적화 (1) | 2024.04.10 |

|---|---|

| Docker 배포 (0) | 2024.04.03 |

| Docker Compose (0) | 2024.03.21 |

| Amazon Bedrock과 Langchain Workshop (0) | 2024.03.21 |

| Docker network (0) | 2024.03.20 |